Ciencia y Tecnología

Samsung va a empezar a fabricar memoria HBM4 en febrero con una misión clara: romper el monopolio de SK Hynix en IA

Samsung Electronics va a empezar en febrero, de forma inminente, la fabricación de memorias HBM4, la siguiente generación de chips de alta velocidad que alimentan los aceleradores de IA. Ya ha superado las pruebas de cualificación tanto de NVIDIA como de AMD, según fuentes de la industria citadas por Reuters y Korea Economic Daily.

Las primeras entregas irán a NVIDIA para su plataforma Vera Rubin, cuyo CEO, Jensen Huang, ha confirmado que ya está en producción con un lanzamiento previsto para la segunda mitad de 2026.

Por qué es importante. Este movimiento está llamado a cambiar el equilibrio de poder en el mercado de memoria para IA, donde SK Hynix ha sido el proveedor dominante de NVIDIA. La demanda de chips HBM se ha disparado con el auge de la IA generativa, y eso los ha convertido en uno de los cuellos de botella más críticos de la industria tecnológica.

- Para NVIDIA, diversificar el suministro reduce el riesgo de depender de un solo proveedor cuando la demanda de sus aceleradores supera por mucho su capacidad.

- Para Samsung, recuperar terreno significa acceder a unos ingresos por valor de decenas de miles de millones anuales en un momento crítico: necesita este impulso porque precisamente SK Hynix ha erosionado una parte de su negocio.

Entre líneas. Samsung ha jugado una carta arriesgada: adoptar un proceso de fabricación de DRAM de 10 nanómetros de sexta generación (1c) antes que nadie, a pesar de sufrir rendimientos iniciales muy bajos. También ha integrado un chip lógico de 4 nanómetros, más avanzado que el de SK Hynix.

La apuesta está dando frutos: los chips HBM4 de Samsung alcanzaron velocidades de 10,7 gigabits por segundo en las pruebas de NVIDIA, superando el umbral de los 10 Gbps. SK Hynix registró 8,3 Gbps y Micron alrededor de 8 Gbps, según una fuente técnica citada por Korea Herald.

- El cambio en los criterios de cualificación ha favorecido a Samsung. Nvidia y AMD han endurecido los requisitos de velocidad pero han relajado los límites térmicos porque priorizan el rendimiento bruto.

- Esto ocurre después de que aceleradores como los TPU de Google hayan demostrado un rendimiento comparable a las GPU de NVIDIA.

Sí, pero. SK Hynix ya está manos a la obra para evitar perder terreno: ha rediseñado sus chips HBM4 y espera los resultados de nuevas calificaciones que le dejen en ventaja. En febrero empezará a desplegar obleas en su nueva planta M15X en Cheongju para producir chips HBM.

Además, SK Hynix cerró en octubre todos los acuerdos de suministro HBM con sus mayores clientes para 2026. Samsung llega después, intentando arañar la cuota que pueda, gracias a que todos los fabricantes operan al límite de su capacidad.

El trasfondo geopolítico. Corea del Sur concentra más del 70% de la producción mundial de chips HBM, un componente tan crítico para la IA que determina quién puede entrenar los modelos más avanzados y quién no.

China, pese a sus descomunales inversiones en semiconductores, sigue unos años por detrás en esta tecnología por las restricciones occidentales sobre equipos de litografía avanzada. El dominio surcoreano en HBM es una de las ventajas más valiosas que mantiene el bloque tecnológico occidental.

Y ahora qué. Ambas empresas tienen que publicar este jueves sus resultados trimestrales. Y es de esperar que aprovechen para dar más detalles sobre los pedidos de HBM4 y la demanda real. Esos números dirán mucho sobre quién está ganando esta batalla por el componente más valioso de la era de la IA.

En Xataka | Hay una víctima inesperada de la escalada de precios de las memorias RAM: los modernísimos coches conectados

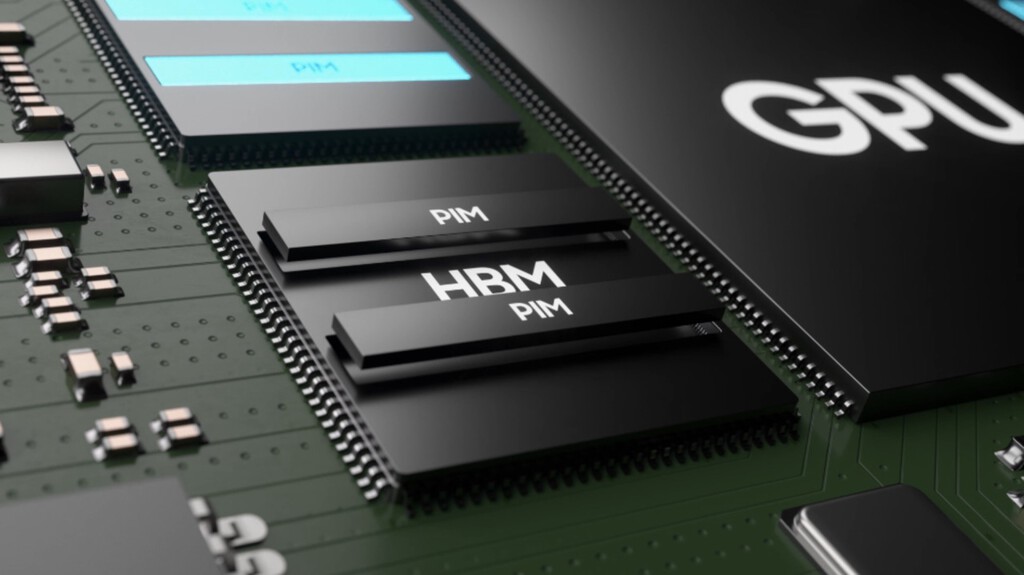

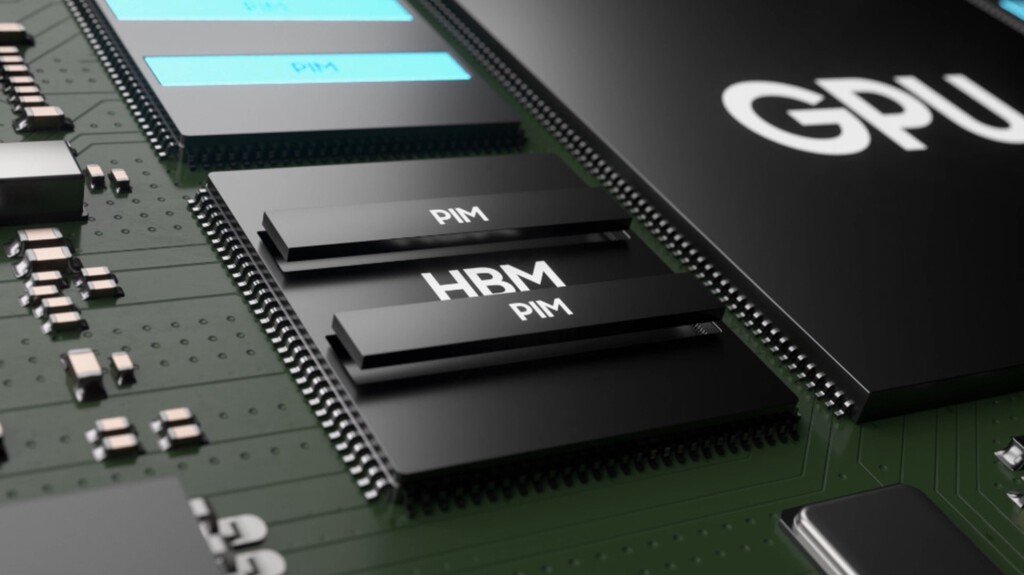

Imagen destacada | Samsung

–

La noticia

Samsung va a empezar a fabricar memoria HBM4 en febrero con una misión clara: romper el monopolio de SK Hynix en IA

fue publicada originalmente en

Xataka

por

Javier Lacort

.

Samsung Electronics va a empezar en febrero, de forma inminente, la fabricación de memorias HBM4, la siguiente generación de chips de alta velocidad que alimentan los aceleradores de IA. Ya ha superado las pruebas de cualificación tanto de NVIDIA como de AMD, según fuentes de la industria citadas por Reuters y Korea Economic Daily.

Las primeras entregas irán a NVIDIA para su plataforma Vera Rubin, cuyo CEO, Jensen Huang, ha confirmado que ya está en producción con un lanzamiento previsto para la segunda mitad de 2026.

Por qué es importante. Este movimiento está llamado a cambiar el equilibrio de poder en el mercado de memoria para IA, donde SK Hynix ha sido el proveedor dominante de NVIDIA. La demanda de chips HBM se ha disparado con el auge de la IA generativa, y eso los ha convertido en uno de los cuellos de botella más críticos de la industria tecnológica.

Para NVIDIA, diversificar el suministro reduce el riesgo de depender de un solo proveedor cuando la demanda de sus aceleradores supera por mucho su capacidad.Para Samsung, recuperar terreno significa acceder a unos ingresos por valor de decenas de miles de millones anuales en un momento crítico: necesita este impulso porque precisamente SK Hynix ha erosionado una parte de su negocio.

En Xataka

Sandisk ha subido un 1.000% en bolsa desde verano. Su ventaja se llama Kioxia

Entre líneas. Samsung ha jugado una carta arriesgada: adoptar un proceso de fabricación de DRAM de 10 nanómetros de sexta generación (1c) antes que nadie, a pesar de sufrir rendimientos iniciales muy bajos. También ha integrado un chip lógico de 4 nanómetros, más avanzado que el de SK Hynix.

La apuesta está dando frutos: los chips HBM4 de Samsung alcanzaron velocidades de 10,7 gigabits por segundo en las pruebas de NVIDIA, superando el umbral de los 10 Gbps. SK Hynix registró 8,3 Gbps y Micron alrededor de 8 Gbps, según una fuente técnica citada por Korea Herald.

El cambio en los criterios de cualificación ha favorecido a Samsung. Nvidia y AMD han endurecido los requisitos de velocidad pero han relajado los límites térmicos porque priorizan el rendimiento bruto.Esto ocurre después de que aceleradores como los TPU de Google hayan demostrado un rendimiento comparable a las GPU de NVIDIA.

Sí, pero. SK Hynix ya está manos a la obra para evitar perder terreno: ha rediseñado sus chips HBM4 y espera los resultados de nuevas calificaciones que le dejen en ventaja. En febrero empezará a desplegar obleas en su nueva planta M15X en Cheongju para producir chips HBM.

Además, SK Hynix cerró en octubre todos los acuerdos de suministro HBM con sus mayores clientes para 2026. Samsung llega después, intentando arañar la cuota que pueda, gracias a que todos los fabricantes operan al límite de su capacidad.

El trasfondo geopolítico. Corea del Sur concentra más del 70% de la producción mundial de chips HBM, un componente tan crítico para la IA que determina quién puede entrenar los modelos más avanzados y quién no.

China, pese a sus descomunales inversiones en semiconductores, sigue unos años por detrás en esta tecnología por las restricciones occidentales sobre equipos de litografía avanzada. El dominio surcoreano en HBM es una de las ventajas más valiosas que mantiene el bloque tecnológico occidental.

Y ahora qué. Ambas empresas tienen que publicar este jueves sus resultados trimestrales. Y es de esperar que aprovechen para dar más detalles sobre los pedidos de HBM4 y la demanda real. Esos números dirán mucho sobre quién está ganando esta batalla por el componente más valioso de la era de la IA.

En Xataka | Hay una víctima inesperada de la escalada de precios de las memorias RAM: los modernísimos coches conectados

Imagen destacada | Samsung

– La noticia

Samsung va a empezar a fabricar memoria HBM4 en febrero con una misión clara: romper el monopolio de SK Hynix en IA

fue publicada originalmente en

Xataka

por

Javier Lacort

.