Ciencia y Tecnología

La máquina de promesas de OpenAI también falla: el caso de las matemáticas demuestra que el hype amenaza con explotarles en la cara

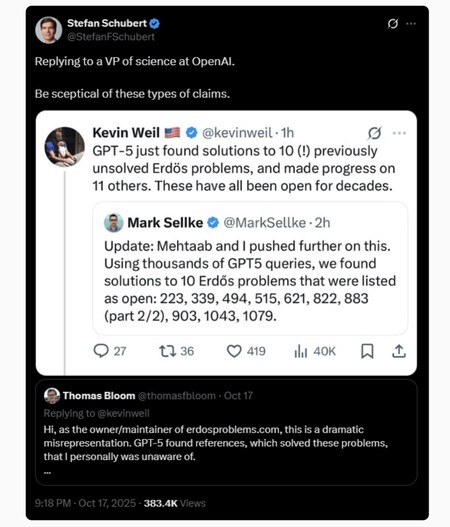

Un grupo de investigadores de OpenAI afirmaron haber “encontrado soluciones para 10 problemas de Erdös que previamente no se habían resuelto, y se ha hecho progreso en otros 11”. La afirmación parecía indicar que GPT-5 había dado un salto cualitativo importante en el ámbito de las matemáticas, pero la realidad era muy distinta. De hecho, todo resultó ser una exageración que puede perjudicar la reputación de OpenAI de cara al futuro.

Qué ha pasado. La afirmación de los ingenieros de OpenAI era prometedora, pero exagerada. Al mensaje original de Mark Selke, uno de ellos, se le sumaron los de otros investigadores como Boris Power —que se disculpó tras darse cuenta de que habían metido la pata—, o Sebastian Bubeck —que también acabó modificando el tuit y reconoció el error—. El tuit original parecía dejar claro que GPT-5 había logrado solucionar varios de los célebres problemas matemáticos de Erdös. En realidad no los había solucionado.

GPT-5 sirvió para buscar las soluciones. El matemático Thomas Bloom, que precisamente se encarga de gestionar el sitio web en el se gestionan todos esos problemas abiertos, aclaró la situación rápidamente. Como explicó en X/Twitter, las afirmaciones de OpenAI eran “una interpretación dramáticamente errónea”. Cuando él habla de que de problemas “abiertos” (“open”) en el sitio web lo que quiere decir es que él no conoce la solución, no que ese problema no haya sido resuelto. Lo único que hizo GPT-5 fue encontrar investigaciones y estudios recientes que Bloom no había encontrado. Aquí debemos decir que la IA sí ha logrado realizar avances matemáticos llamativos recientemente: Meta AI, por ejemplo, logró generalizar la función de Lyapunov.

Demis Hassabis y Yann LeCun critican a OpenAI. Demis Hassabis, CEO de DeepMind, indicó en X que este suceso había sido “vergonzoso”, mientras que Yann LeCun, uno de los máximos responsables de IA en Meta, destacó cómo OpenAI se había creído su propio mensaje de venta de hype con el mensaje “Hoisted by their own GPTards”, que juega con GPT y “tards” (un sufijo derivado de “retards”, “retrasados”), en referencia a los crédulos en las expectativas que vende OpenAI habitualmente.

Las expectativas lo son todo. Aunque los investigadores e ingenieros de OpenAI admitieron su error, lo que vemos aquí es un patrón peligroso: uno en el que hasta los propios empleados de la empresa —o los entusiastas que la siguen— pueden acabar siendo víctimas de esas expectativas. Es muy probable que internamente la presión por lograr grandes avances con sus modelos sea enorme, pero eso puede hacer que haya descuidos y exageraciones como esta que pueden costar caro a la reputación de la empresa.

GPT-5 no lo hizo mal del todo. Aunque se exageró el papel de GPT-5 en este proceso, lo que sí hay que reconocer es que este modelo demostró su capacidad para convertirse en un asistente muy valioso para investigadores. Así, este modelo de IA puede recorrer internet y las librerías de estudios científicos de forma muy potente, y puede “encontrar soluciones” ya publicadasdonde los académicos aún no las habían visto al intentar resolver problemas relacionados.

Ayudante para la investigación. Para el matemático Terence Tao ese es precisamente un elemento muy llamativo de estos modelos de IA: puede que no resuelvan los problemas matemáticos más complejos, pero pueden acelerar tareas tediosas como las de la búsqueda de literatura académica que ayude a resolverlos. Para este experto la IA puede ayudar a “industrializar” las matemáticas y actuar como un catalizador o un “lubricante” para las hipótesis y teorías de los matemáticos.

Pero esto es importante. OpenAI es una máquina de crear expectativas, y su CEO, Sam Altman, no duda en realizar promesas difusas e imposibles de verificar para lograr captar más interés por sus modelos de inteligencia artificial generativa. Hace un año prometió que la AGI llegaría “en unos miles de días”, algo que suena a una de esas “promesas de Musk”.

Apuesta arriesgada. En las últimas semanas hemos visto cómo OpenAI ha llegado a singulares acuerdos de financiación circular con NVIDIA, AMD o Broadcom para crear centros de datos, pero la realidad es que todos esos proyectos se centran en una promesa: la de que la IA será parte fundamental de nuestra vida más temprano que tarde. Eso puede pasar, desde luego, pero si no ocurre el efecto dominó puede ser una absoluta catástrofe dadas las decenas de miles de millones de dólares invertidos en dichos proyectos.

Imagen | Vitaly Gariev

–

La noticia

La máquina de promesas de OpenAI también falla: el caso de las matemáticas demuestra que el hype amenaza con explotarles en la cara

fue publicada originalmente en

Xataka

por

Javier Pastor

.

Un grupo de investigadores de OpenAI afirmaron haber “encontrado soluciones para 10 problemas de Erdös que previamente no se habían resuelto, y se ha hecho progreso en otros 11”. La afirmación parecía indicar que GPT-5 había dado un salto cualitativo importante en el ámbito de las matemáticas, pero la realidad era muy distinta. De hecho, todo resultó ser una exageración que puede perjudicar la reputación de OpenAI de cara al futuro.Qué ha pasado. La afirmación de los ingenieros de OpenAI era prometedora, pero exagerada. Al mensaje original de Mark Selke, uno de ellos, se le sumaron los de otros investigadores como Boris Power —que se disculpó tras darse cuenta de que habían metido la pata—, o Sebastian Bubeck —que también acabó modificando el tuit y reconoció el error—. El tuit original parecía dejar claro que GPT-5 había logrado solucionar varios de los célebres problemas matemáticos de Erdös. En realidad no los había solucionado.

GPT-5 sirvió para buscar las soluciones. El matemático Thomas Bloom, que precisamente se encarga de gestionar el sitio web en el se gestionan todos esos problemas abiertos, aclaró la situación rápidamente. Como explicó en X/Twitter, las afirmaciones de OpenAI eran “una interpretación dramáticamente errónea”. Cuando él habla de que de problemas “abiertos” (“open”) en el sitio web lo que quiere decir es que él no conoce la solución, no que ese problema no haya sido resuelto. Lo único que hizo GPT-5 fue encontrar investigaciones y estudios recientes que Bloom no había encontrado. Aquí debemos decir que la IA sí ha logrado realizar avances matemáticos llamativos recientemente: Meta AI, por ejemplo, logró generalizar la función de Lyapunov.Demis Hassabis y Yann LeCun critican a OpenAI. Demis Hassabis, CEO de DeepMind, indicó en X que este suceso había sido “vergonzoso”, mientras que Yann LeCun, uno de los máximos responsables de IA en Meta, destacó cómo OpenAI se había creído su propio mensaje de venta de hype con el mensaje “Hoisted by their own GPTards”, que juega con GPT y “tards” (un sufijo derivado de “retards”, “retrasados”), en referencia a los crédulos en las expectativas que vende OpenAI habitualmente.Las expectativas lo son todo. Aunque los investigadores e ingenieros de OpenAI admitieron su error, lo que vemos aquí es un patrón peligroso: uno en el que hasta los propios empleados de la empresa —o los entusiastas que la siguen— pueden acabar siendo víctimas de esas expectativas. Es muy probable que internamente la presión por lograr grandes avances con sus modelos sea enorme, pero eso puede hacer que haya descuidos y exageraciones como esta que pueden costar caro a la reputación de la empresa.

GPT-5 no lo hizo mal del todo. Aunque se exageró el papel de GPT-5 en este proceso, lo que sí hay que reconocer es que este modelo demostró su capacidad para convertirse en un asistente muy valioso para investigadores. Así, este modelo de IA puede recorrer internet y las librerías de estudios científicos de forma muy potente, y puede “encontrar soluciones” ya publicadasdonde los académicos aún no las habían visto al intentar resolver problemas relacionados.

Ayudante para la investigación. Para el matemático Terence Tao ese es precisamente un elemento muy llamativo de estos modelos de IA: puede que no resuelvan los problemas matemáticos más complejos, pero pueden acelerar tareas tediosas como las de la búsqueda de literatura académica que ayude a resolverlos. Para este experto la IA puede ayudar a “industrializar” las matemáticas y actuar como un catalizador o un “lubricante” para las hipótesis y teorías de los matemáticos.

Pero esto es importante. OpenAI es una máquina de crear expectativas, y su CEO, Sam Altman, no duda en realizar promesas difusas e imposibles de verificar para lograr captar más interés por sus modelos de inteligencia artificial generativa. Hace un año prometió que la AGI llegaría “en unos miles de días”, algo que suena a una de esas “promesas de Musk”.

En Xataka

OpenAI está consiguiendo que la industria tech una su destino al suyo. Por el bien de la economía mundial, más vale que funcione

Apuesta arriesgada. En las últimas semanas hemos visto cómo OpenAI ha llegado a singulares acuerdos de financiación circular con NVIDIA, AMD o Broadcom para crear centros de datos, pero la realidad es que todos esos proyectos se centran en una promesa: la de que la IA será parte fundamental de nuestra vida más temprano que tarde. Eso puede pasar, desde luego, pero si no ocurre el efecto dominó puede ser una absoluta catástrofe dadas las decenas de miles de millones de dólares invertidos en dichos proyectos.Imagen | Vitaly GarievEn Xataka | Si la pregunta es si hay una burbuja de la IA, Sam Altman acaba de dar respuesta. Una con la que él sale ganando

– La noticia

La máquina de promesas de OpenAI también falla: el caso de las matemáticas demuestra que el hype amenaza con explotarles en la cara

fue publicada originalmente en

Xataka

por

Javier Pastor

.